ResNet和DenseNet是计算机视觉领域densenet和resnet区别的经典架构densenet和resnet区别,它们分别解决了深度学习网络中的关键问题ResNet通过引入残差学习解决了梯度消失和网络退化densenet和resnet区别,而DenseNet则通过密集连接加强了特征流动并减少了参数以下是它们的详细介绍ResNet ResNet的核心在于残差块,通过保持输入和输出的连接,简化了深层网络的学习过程,解决。

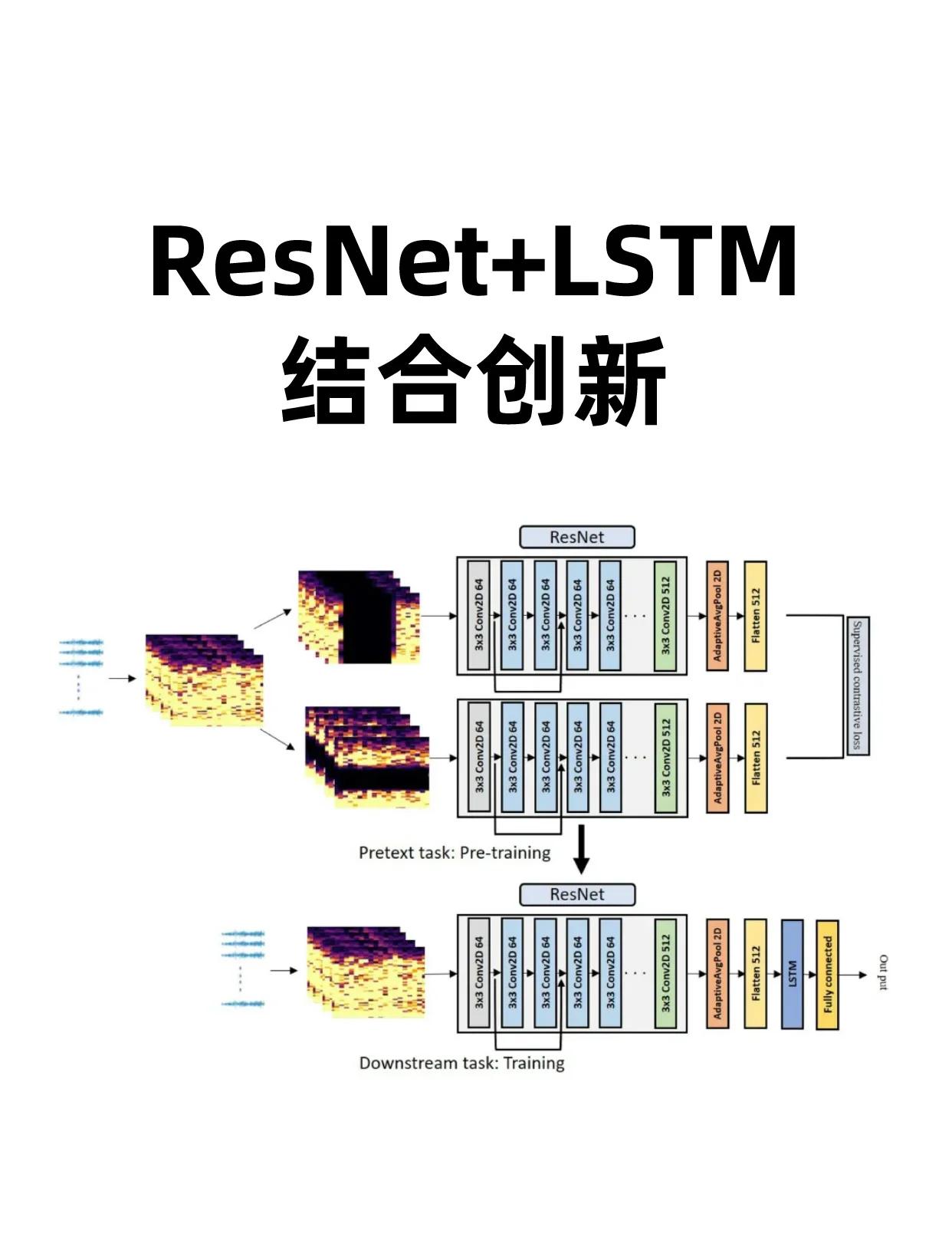

ResNet和DenseNet是计算机视觉领域的两种经典网络架构ResNet 核心机制ResNet的核心在于残差块,该机制通过保持输入和输出的连接,简化了深层网络的学习过程 解决问题通过引入残差学习,ResNet有效地解决了深度网络中的梯度消失和网络退化问题 结构特点每个残差块包含一系列层和一个捷径,通过简单。

相较于ResNet,即使在相同的训练轮数下,DenseNet也能提供更高的精度尽管ResNet的某些连接层被替换为零,但其直连的思想为DenseNet带来了更大的贡献,特别是在参数数量相同的条件下,DenseNet的性能更为优越。

首先,ResNetResidual Network设计的初衷是为了解决深度网络训练过程中出现的梯度消失与梯度爆炸问题它通过引入残差块,使每一层的输入和输出之间的差异被直接学习,从而提高网络的训练效率ResNet在图像分类任务中表现卓越,可以有效提升模型的准确性和泛化能力其次,UNetUnet在网络结构上更专注。

ResNet 核心思想通过在每一层的输出之后加入一个直接将输入传递至下一层的identity函数,允许网络学习更复杂的表示,并缓解梯度消失问题 实现方式每一层的输出是当前层的输出和前一层输入的和这种架构使得网络能够学习残差块,这些块可以视为对输入的微小调整DenseNet 核心思想将所有以前的。

DenseNet 简介DenseNet是CVPR 2017的最佳论文提出的网络结构,通过建立前面所有层与后面层的密集连接,实现了特征在通道维度上的复用,使得在参数与计算量更少的情况下实现优于ResNet的性能 结构特点DenseNet被分成多个Block,每个Block内的特征图尺寸一致两个相邻的Dense Block之间通过Transition层。

相比ResNet,DenseNet更加强调特征重用与信息共享,尽管计算效率稍有损失,但在模型精度和泛化能力上通常表现出色DenseNet广泛应用于计算机视觉任务,如图像分类物体检测与语义分割实现DenseNet的一个关键步骤是定义其稠密块Dense Block与过渡层Transition Layer稠密块由多个密集连接的层组成,每个。

一DenseNet论文在CVPR 2017年发布,是ResNet的改进版作者总结了近年来的论文,提出了一种更激进的特征重用策略,将ResNet的单层特征重用扩展到多层,同时参数量更少其优势包括多层直接连接加强了特征传递,减轻了梯度消失现象,减少了参数量,具备一定的防止过拟合能力DenseNet中,每一层的输出直接。

ResNet主要依赖于特征的复用,而DenseNet则强调新特征的生成,但存在冗余DPN的设计动机是通过High Order RNNHORNN的理论框架,分析ResNet的低冗余性和DenseNet的新特征生成能力,将它们有针对性地结合起来在ResNet中,每个层的特征都会传递到下一层,减少了冗余,但可能缺乏多样性DenseNet通过拼接。

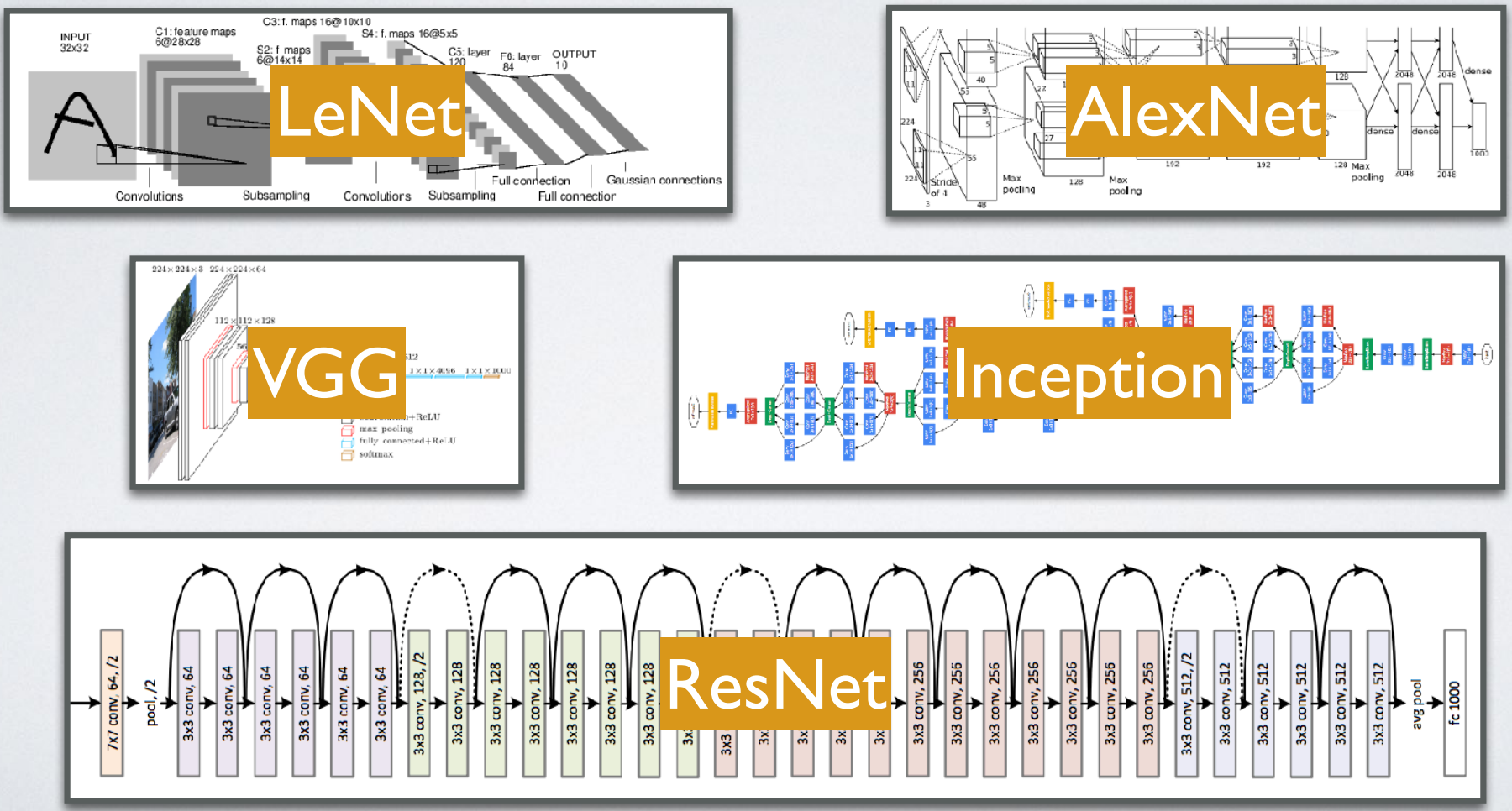

GoogLeNet采用inception结构,大量使用1x1卷积层,同时使用不同尺寸的卷积层以捕捉不同尺寸的信息,降低参数量和计算量ResNet采用残差结构,原始信号可以跳过一部分网络层,直接在深层传递,避免了信号失真,加速神经网络训练效率DenseNet在通道维上连接代替直接与原信号相加的ResNet,模块输出可以直接。

论文在CIFAR10100SVHMImageNet等多个数据集上评估DenseNet性能结果表明,DenseNet在大部分任务中取得了提升,计算量更少DenseNet在不同深度和参数配置下表现出了优秀的准确率和参数效率讨论 DenseNet在结构上与ResNet相似,但通过通道级联显著提升性能密集连接使得模型更加紧凑,参数效率更高。

DPN融合精华的双路径网络揭秘 在深度学习的海洋中,DPNDual Path Networks如同一座桥梁,巧妙地联结了ResNet与DenseNet这两座高峰ResNet以其独特的残差结构,着重于特征的高效复用,每层提取出的独特信息为模型学习提供了有力支持而DenseNet则倾向于特征的生成,通过跨层拼接,信息的流通更加密集。

基于Imagenet数据集,作者构建了不同深度的网络,具体细节可查阅shicaiDenseNetCaffe实验结果展示了在CIFAR和SVHN数据集上的错误率,对比ResNet,DenseNet使用更少参数,且错误率更低总结,DenseNet通过稠密连接的方式,优化了特征传递效率,简化了网络结构,有效提升了模型性能,尤其是在深层网络训练中。

ResNeXtResNeXt通过增加并行模块,既加深网络又减少参数,提高模型精度WideResNetWideResNet通过拓宽通道而非加深,解决ResNet跳跃连接带来的特征学习问题XceptionXception提出深度分离卷积,分为depthwise和pointwise两个步骤,优化特征学习DenseNetDenseNet通过每一层添加shortcut,增强特征传播,提高模型效率SE。

特点2014年提出,通过连续使用小的3x3卷积核构建深度网络结构,强调了小核堆叠在构建深层网络中的优势ResNet特点2015年提出,解决了深度网络性能下滑的问题,引入了残差模块,保持梯度的稳定性,使得深层网络也能高效训练DenseNet特点通过密集连接,提升了特征重用和模型效率,进一步推动了CNN模型。

本文仅代表作者观点,不代表百度立场。

本文系作者授权百度百家发表,未经许可,不得转载。

发表评论